Deepfakes et Arnaques Milliardaires : Quand l’IA Devient l’Arme Fatale des Cybercriminels

Comment une simple visioconférence a coûté 25,6 millions de dollars à une multinationale et ce que cela signifie pour l’avenir de la cybersécurité

Introduction : Le jour où la réalité a basculé

En tant que consultant en IA et cybersécurité depuis plus de 8 ans, j’ai assisté à de nombreuses évolutions technologiques. Mais rares sont celles qui m’ont fait réaliser à quel point nous avions sous-estimé la sophistication des menaces émergentes. L’affaire Arup de février 2024 est l’un de ces moments marquants.

Imaginez un instant : vous êtes un cadre financier expérimenté dans une multinationale britannique prestigieuse. Vous recevez un email de votre CFO basé à Londres demandant une transaction confidentielle. Méfiant, vous rejoignez une visioconférence pour confirmation. À l’écran, vous reconnaissez parfaitement votre directeur financier, ses collègues, leurs mimiques, leurs voix familières. Tout semble légitime. Vous validez le virement.

Le problème ? Tous les participants étaient des deepfakes générés par IA.

Résultat : 25,6 millions de dollars transférés en 15 transactions vers 5 comptes bancaires frauduleux. L’arnaque n’a été découverte qu’une semaine plus tard, lorsque l’employé a vérifié auprès du siège social.

Cet article analyse cette affaire emblématique, explore la montée en puissance des deepfakes dans la criminalité financière, et partage mon expérience sur les stratégies de protection que chaque entreprise doit adopter dès maintenant.

L’Anatomie d’une Arnaque Parfaite : Le Cas Arup

Le Contexte

Arup, cabinet d’ingénierie et de design mondiallement reconnu, a vu son bureau de Hong Kong ciblé par ce que les experts considèrent comme l’une des arnaques IA les plus sophistiquées à ce jour.

La Méthode des Attaquants

D’après l’analyse forensique de l’incident, les cybercriminels ont déployé une stratégie en plusieurs phases :

- Reconnaissance intensive : Les attaquants ont collecté des vidéos et extraits audio des dirigeants d’Arup disponibles publiquement (interviews, webinaires, conférences) pendant des mois pour entraîner leurs modèles IA.

- Phishing initial : Un email usurpant l’identité du CFO britannique demandant une « transaction secrète » — classique, mais suffisant pour éveiller les soupçons initiaux.

- La supercherie visuelle : L’employé méfiant a été invité à une visioconférence où tous les participants étaient des deepfakes créés par IA générative. Les technologies utilisées combinaient probablement des GANs (Generative Adversarial Networks) et des modèles de diffusion pour générer vidéo et audio en temps réel.

- Exploitation de la confiance visuelle : L’authenticité apparente de la réunion a dissipé tous les doutes. L’employé a exécuté 15 virements totalisant 200 millions de dollars hongkongais.

Ce qui rend cette attaque particulièrement alarmante, selon Rob Greig, Chief Intelligence Officer d’Arup : « Les attaquants n’ont compromis aucun système ou donnée ; ils ont perpétré une attaque d’ingénierie sociale convaincante. »

Une Tendance Inquiétante : L’Évolution des Fraudes IA

La Trajectoire des Pertes Financières

L’affaire Arup n’est malheureusement pas un cas isolé. L’évolution des pertes financières liées aux deepfakes dessine une courbe exponentielle préoccupante :

Les chiffres clés :

| Année | Incident | Montant perdu | Technologie utilisée |

|---|---|---|---|

| 2019 | UK Energy Firm | 243 000 $ | Voice cloning (CEO fraud) |

| 2020 | Japanese Company HK | 35 millions $ | Deepfake audio + vidéo |

| 2024 | Arup Hong Kong | 25,6 millions $ | Vidéoconférence deepfake |

| 2027 (prévu) | Projections globales | 40 milliards $ | Multi-technologie |

Les Différentes Modalités d’Attaque

D’après mes recherches et l’analyse du Carnegie Endowment for International Peace, les deepfakes servent désormais 10 scénarios de criminalité financière distincts :

Ciblant les individus :

- Vol d’identité par clonage vocal ou vidéo

- Arnaques à l’imposteur (faux proches en détresse)

- Cyber-extorsion via contenu synthétique compromettant

Ciblant les entreprises :

- Fraude au paiement (CEO fraud amélioré)

- Manipulation boursière via événements fabriqués

- Campagnes de désinformation par bots synthétiques

Ciblant les marchés et régulateurs :

- Crashes boursiers provoqués par fausses annonces

- Faux communiqués gouvernementaux

- Astroturfing réglementaire

Pourquoi Cela Fonctionne : La Psychologie de la Confiance Violée

Dans mon accompagnement des entreprises victimes de cyberattaques, j’observe toujours le même schéma psychologique. Les deepfakes exploitent ce que les chercheurs appellent « l’autorité visuelle » — notre cerveau accorde une confiance disproportionnée aux stimuli visuels familiers.

Les Facteurs de Succès des Attaquants

1. La crédibilité contextuelle

Les fraudeurs d’Arup n’ont pas seulement imité des visages ; ils ont recréé un environnement social crédible. Une réunion avec plusieurs collègues connus crée un effet de validation sociale puissant.

2. L’urgence artificielle

Les demandes de transaction « secrète » ou « urgente » désactivent les mécanismes de vérification rationnels. Le stress cognitif rend la détection des anomalies plus difficile.

3. L’asymétrie technologique

Comme le note le rapport du National Counterterrorism Innovation Center, seulement 3 secondes d’audio suffisent désormais pour créer un clone vocal convaincant. Les barrières techniques pour les attaquants s’effondrent.

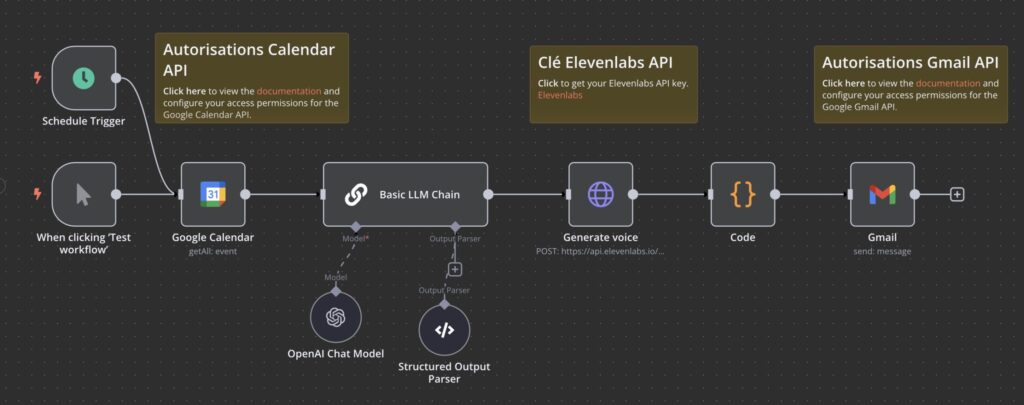

Stratégies de Défense : Le Cadre que J’Implante chez Mes Clients

Face à cette menace, la réaction ne peut être que multidimensionnelle. Voici le framework que je déploie systématiquement :

1. L’Éducation Adaptée (Première Ligne)

Les formations traditionnelles à la cybersécurité sont obsolètes. Je recommande désormais des simulations immersives où les employés confrontent des deepfakes réels (mais inoffensifs) pour développer leur « literacy médiatique ».

Points clés à communiquer :

- Méfiance systématique face aux demandes financières urgentes, même visuellement « prouvées »

- Vérification par canal secondaire indépendant (appel direct sur numéro connu)

- Signes subtils de deepfakes : synchronisation labiale imparfaite, éclairage incohérent, absence de clignements naturels

2. Les Protocoles de Vérification Multi-Niveaux

| Type de transaction | Protocole requis |

|---|---|

| < 10 000 $ | Double validation email + confirmation vocale |

| 10 000 $ – 100 000 $ | Vérification vidéo en direct avec mot de passe familial pré-établi |

| > 100 000 $ | Validation en personne ou via canal cryptographiquement sécurisé |

3. L’IA contre l’IA : Outils de Détection

Ironiquement, la lutte contre les deepfakes nécessite l’IA elle-même. Les solutions de détection avancées analysent :

- Les micro-inconsistances dans les flux vidéo (fréquence des clignements, flux sanguin facial)

- Les artefacts audio (réverbération artificielle, plages fréquentielles anormales)

- Les métadonnées blockchain pour l’authenticité

4. L’Authentification Continue

Au-delà du mot de passe unique, j’implante des systèmes d’authentification continue comportementale — l’IA apprend les patterns de communication authentiques des dirigeants pour détecter les anomalies.

L’Enjeu Réglementaire et Éthique

Le Cadre Légal en Évolution

Aux États-Unis, la FCC a reclassé les appels vocaux générés par IA comme des « robocalls » illégaux sans consentement explicite. Cependant, la législation peine à suivre la vitesse d’évolution technologique.

La Responsabilité des Plateformes

Les grandes plateformes de visioconférence (Zoom, Teams, Meet) doivent intégrer nativement la détection de deepfakes. Certains acteurs comme Microsoft commencent à déployer des watermarks IA, mais cela reste insuffisant.

L’Éthique de la Recherche

En tant que professionnel de l’IA, je suis confronté au dilemme suivant : les mêmes technologies qui permettent ces fraudes (GANs, diffusion models, voice cloning) ont des applications légitimes précieuses (accessibilité, entertainment, éducation). La régulation doit cibler l’usage malveillant sans étouffer l’innovation.

Conclusion : La Nouvelle Ère de la Méfiance Constructive

L’affaire des 25,6 millions d’Arup marque un tournant. Nous entrons dans une ère où le doute systématique devient une compétence professionnelle essentielle. Ce n’est pas pessimisme ; c’est adaptation.

Pour les entreprises, le message est clair : l’investissement en cybersécurité doit désormais inclure une composante « anti-deepfake » non négociable. Pour les individus, la vigilance face aux demandes financières doit devenir réflexe, quelle que soit l’apparente authenticité visuelle.

Dans mon accompagnement, je vois déjà des entreprises transformer cette menace en opportunité de renforcement de leurs processus. Celles qui adoptent une posture proactive aujourd’hui constitueront l’avant-garde de la résilience numérique de demain.

La technologie n’est ni bonne ni mauvaise — elle amplifie les intentions. Notre rôle est de construire les garde-fous qui permettront à l’IA de rester un outil de progrès, pas une arme de destruction massive de la confiance.

- Le Phénomène Anti-IA : De la Méfiance à la Révolte Mondiale

- Lunettes intelligentes et fraude : une nouvelle ère de criminalité dopée à l’IA

- GPT-5.5 vs Claude Opus 4.7 vs Kimi K2.6 : Le Comparatif Ultime des Géants de l’IA (Avril 2026)

- Claude Design : L’Outil qui Redéfinit la Chaîne de Création Digitale

- Anthropic Lance Sa Conquête des Puces IA : Pourquoi Claude Nécessite Son Propre Silicon [Analyse 2026]