Nvidia GTC 2026 : L’Ère de l’Inférence est Arrivée – Ce que cela Change pour Votre Stratégie IA

Le Moment où Tout a Basculé

Je regardais la keynote de Jensen Huang (patron de nvidia) au GTC 2026, et une phrase a retenu mon attention : « L’IA ne s’entraîne plus, elle travaille. » Cette déclaration, lancée devant 30 000 développeurs au SAP Center de San José, marque un tournant historique pour notre industrie.

En tant qu’architecte de solutions IA et spécialiste de l’automatisation n8n, j’ai assisté à de nombreuses évolutions technologiques. Mais ce que Nvidia vient d’annoncer dépasse le simple cycle de mise à jour hardware. Nous entrons dans une nouvelle ère qui redéfinira complètement notre approche de l’intelligence artificielle en production.

Le Rachat Stratégique de Groq : 20 Milliards $ pour Dominer l’Inférence

Pourquoi cette acquisition change la donne

En décembre 2025, Nvidia a officialisé le rachat de Groq pour environ 20 milliards de dollars. Groq a développé les Language Processing Units (LPU), des puces conçues pour une latence extrêmement faible grâce à une architecture SRAM intégrée.

| Caractéristique | NVIDIA Rubin GPU | Groq 3 LPU |

|---|---|---|

| Mémoire | 288 GB HBM | 500 MB SRAM |

| Bande passante | 22 TB/s | 150 TB/s |

| Performance FP8 | 50 PFLOPS | 1.2 PFLOPS |

| Optimisation | Débit (throughput) | Latence ultra-faible |

Source : NVIDIA Developer Blog, IEEE Spectrum

Dans mes projets d’automatisation n8n, la latence est souvent le facteur limitant. Les LPU réduisent le temps de réponse à quelques millisecondes, rendant les agents IA viables pour des expériences utilisateur fluides.

1 000 Milliards $ de Commandes : La Demande Explose

Jensen Huang a annoncé au moins 1 000 milliards de dollars de commandes d’ici 2027, doublant la prévision précédente de 500 milliards pour fin 2026.

« La demande de calcul a été multipliée par un million en deux ans. » — Jensen Huang

| Année | Prévision | Évolution |

|---|---|---|

| 2026 | 500 milliards $ | — |

| 2027 | 1 000 milliards $ | +100% |

Cette explosion s’explique par l’émergence des modèles de raisonnement et des agents autonomes qui enchaînent des tâches complexes sans intervention humaine.

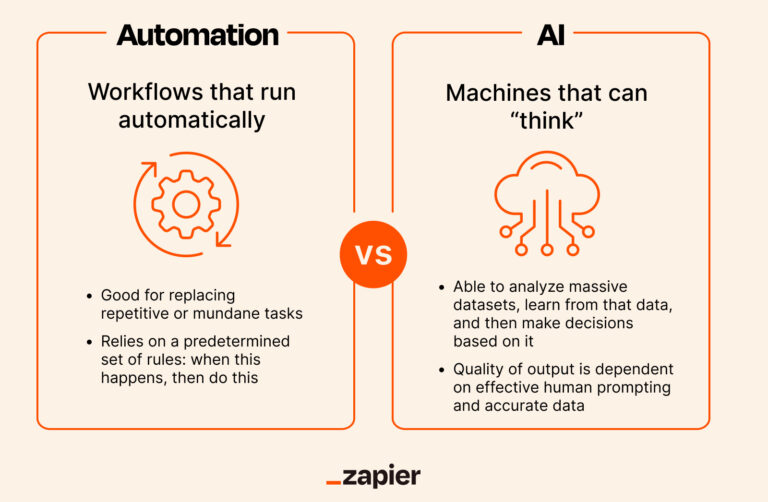

Entraînement vs Inférence : Le Déplacement du Centre de Gravité

Le changement de paradigme

Pendant des années, l’IA s’est concentrée sur l’entraînement : construire des modèles sur des datasets massifs. L’inférence, c’est l’utilisation du modèle pour répondre aux requêtes utilisateurs.Table

| Aspect | Entraînement | Inférence |

|---|---|---|

| Part des coûts | 10-20% | 80-90% |

| Optimisation | Temps d’entraînement | Coût par token |

| Concurrents | NVIDIA dominant | Marché ouvert |

| Latence | Non critique | Critique |

Source : Introl, Stanford AI Index 2025

Le coût de l’inférence peut être 15 à 118 fois plus élevé que l’entraînement sur la durée de vie d’un modèle. D’où l’investissement Nvidia dans les architectures spécialisées.

Vera Rubin et Groq 3 LPX : L’Architecture Hétérogène

La plateforme Vera Rubin NVL72 intègre 72 GPU Rubin et peut être couplée avec des racks Groq 3 LPX (256 LPU). Cette architecture divise intelligemment le travail :

- Rubin GPU : Gère le pré-remplissage et les calculs parallèles

- Groq 3 LPU : Accélère le décode avec latence minimale

Table

| Spécification | Vera Rubin NVL72 | Groq 3 LPX |

|---|---|---|

| GPU/LPU | 72 Rubin GPU | 256 Groq 3 LPU |

| Gain perf. | 3.5× vs Blackwell | 35× throughput |

| Mémoire totale | 2.3 TB HBM | 128 GB SRAM |

Source : NVIDIA, ServeTheHome

Cette combinaison permet d’atteindre 35× le débit d’inférence par mégawatt, tout en maintenant des temps de réponse interactifs.

OpenClaw : Le Linux de l’Agentic AI

Nvidia a mis en avant OpenClaw, un framework open-source pour construire des agents IA autonomes. Jensen Huang le compare à Linux, Kubernetes ou HTML.

« OpenClaw est probablement la release logicielle la plus importante de l’histoire. »

Pour l’entreprise, Nvidia propose NemoClaw avec sandboxing isolé, politiques de sécurité, et privacy router pour garder les données locales.

Implications pour Votre Stratégie IA

Mes recommandations concrètes :

1. Optimisez pour l’inférence Le coût réel se mesure au token généré. Chaque milliseconde impacte l’expérience utilisateur.

2. Préparez-vous à l’agentic AI Vos workflows n8n doivent évoluer vers des architectures capables de gérer des milliers d’appels par session.

3. Évaluez les alternatives Les TPU Google offrent un rapport performance/prix 4,7× supérieur. Le marché de l’inférence est compétitif.

4. Sécurisez vos déploiements Un agent IA a accès à vos données sensibles et exécute du code. Mettez des garde-fous avant la production.

Conclusion : L’Infrastructure Devient le Differentiateur

Le GTC 2026 marque un tournant. L’IA n’est plus une question de modèles uniquement : l’infrastructure sous-jacente devient le facteur différenciant critique.

Pour nous, professionnels de l’automatisation et de l’IA, maîtriser l’optimisation des coûts d’inférence et l’architecture agentique sera le skill différenciant des prochaines années.

La question n’est plus « Quel modèle utiliser ? » mais « Comment déployer des agents performants, sécurisés et économiquement viables à grande échelle ? »

- Le Phénomène Anti-IA : De la Méfiance à la Révolte Mondiale

- Lunettes intelligentes et fraude : une nouvelle ère de criminalité dopée à l’IA

- GPT-5.5 vs Claude Opus 4.7 vs Kimi K2.6 : Le Comparatif Ultime des Géants de l’IA (Avril 2026)

- Claude Design : L’Outil qui Redéfinit la Chaîne de Création Digitale

- Anthropic Lance Sa Conquête des Puces IA : Pourquoi Claude Nécessite Son Propre Silicon [Analyse 2026]