Recrutement IA : Quand l’Algorithme Devient Juge et Partie (Le Cas Workday qui Fait Trembler la Silicon Valley)

Procès en cascade contre les outils IA de recrutement : discrimination algorithmique, biais cachés et responsabilité légale. Découvrez comment sécuriser vos automatisations n8n et rester conforme face aux nouvelles réglementations 2026.

Introduction : Mon Réveil brutal face à la réalité algorithmique

Je me souviens encore de ce matin d’octobre 2025. J’avais fièrement déployé un workflow n8n pour un client du secteur RH — un système automatisé de pré-sélection de CV qui promettait de réduire le temps de traitement de 70%. L’enthousiasme a duré exactement 48 heures. C’est alors qu’un candidat de 52 ans, parfaitement qualifié, a reçu un refus automatique à 3h du matin. Un refus sans explication, sans recours, sans humanité.

Cette expérience a changé ma vision de l’automatisation. Aujourd’hui, avec l’affaire Mobley v. Workday qui fait la une du Monde et menace de transformer le paysage juridique du recrutement IA , je comprends que nous avons franchi un point de non-retour. L’ère de l’IA sauvage dans le recrutement est terminée. Place à l’automatisation éthique, traçable et conforme.

L’Affaire Workday : Un Tsunami Juridique qui Déferle sur l’IA de Recrutement

Le Cas Derek Mobley : Quand l’Algorithme Discrimine à Grande Échelle

En 2023, Derek Mobley, cadre afro-américain de 51 ans, doublement diplômé en informatique et finance, dépose une plainte explosive contre Workday . Son crime ? Avoir envoyé plus de 100 candidatures entre 2017 et 2019 sans jamais obtenir d’entretien. Les refus arrivaient par email automatique, souvent la nuit ou le week-end — signe évident qu’aucun humain n’avait consulté son dossier.

Ce qui rend cette affaire historique : la justice américaine a accepté la qualification de discrimination par l’âge pour les plus de 40 ans et a autorisé l’action collective nationale . La deadline pour rejoindre le procès était fixée au 7 mars 2026 , avec un potentiel d’impact sur des centaines de millions de candidats.

« Ces outils d’IA pratiquent le web scraping pour mieux cerner les candidats. Ils connaissent votre code postal, votre date de naissance, l’université où vous avez étudié… » — Roderick Cooks, avocat de Derek Mobley

La Théorie de l’Agence : Vendeurs et Employeurs, Tous Responsables

Le verdict qui fait trembler l’industrie ? La cour a statué que Workday, en tant que fournisseur logiciel, peut être tenu responsable en tant qu’agent des employeurs utilisant sa plateforme . La juge Rita Lin a écrit que le rôle de Workday dans le recrutement n’est pas moins significatif parce qu’il opère via IA plutôt qu’un humain dans un bureau .

Traduction pour les automatisateurs : Vous ne pouvez plus vous cacher derrière votre outil. Si votre workflow n8n discrimine, c’est votre responsabilité.

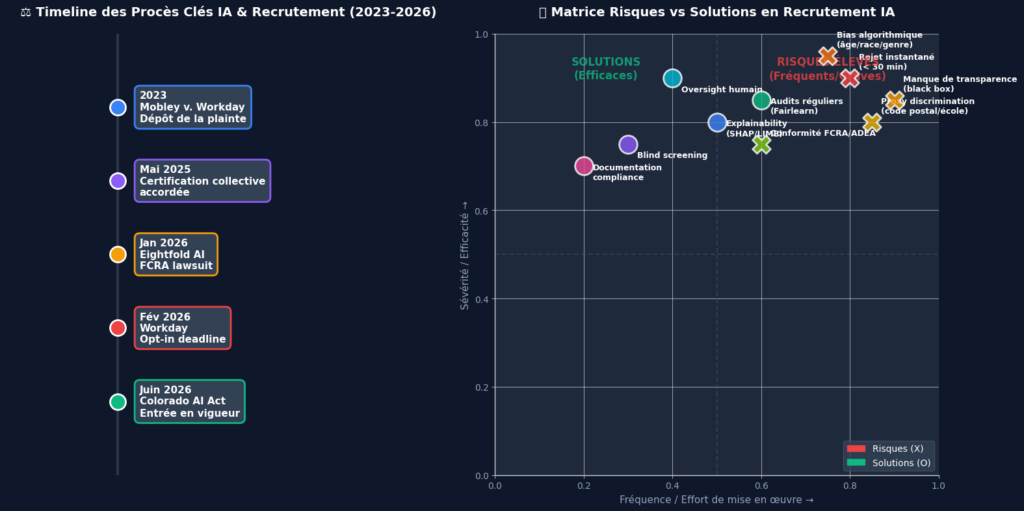

Visualisation : La Cartographie des Risques et Solutions

Analyse visuelle des procès clés 2023-2026 et matrice d’évaluation des risques vs solutions techniques

⚖️ Au-Delà de Workday : La Guerre Juridique s’Intensifie

Eightfold AI et le Fair Credit Reporting Act (FCRA)

En janvier 2026, un autre géant de l’IA de recrutement, Eightfold AI (utilisé par Microsoft, PayPal, Morgan Stanley), fait face à une class action révolutionnaire . L’approche légale est inédite : au lieu de discrimination, les plaignants invoquent le Fair Credit Reporting Act (FCRA) de 1970.

L’accusation ? Eightfold compile des rapports « consommateurs » à partir de données LinkedIn, localisation, historique web — sans consentement ni droit de rectification — pour générer des « Match Scores » de 0 à 5 qui éliminent les candidats avant tout examen humain .

Pourquoi c’est dangereux pour vous : Si votre workflow n8n intègre des API tierces (LinkedIn, Clearbit, Hunter.io) pour enrichir des profils candidats sans consentement explicite, vous entrez dans cette zone grise légale.

HireVue et les Questions d’Accessibilité

En mars 2025, l’ACLU attaque HireVue pour sa plateforme d’entretiens vidéo IA. Une candidate sourde, autochtone, employée chez Intuit avec des évaluations positives, se voit refuser une promotion après un entretien vidéo IA qui n’offrait pas de sous-titrage CART . Le feedback algorithmique ? « Pratiquez l’écoute active. »

Leçon clé : L’accessibilité n’est pas une option. Toute automatisation doit prévoir des accommodations pour les handicaps.

Framework Éthique : Comment Sécuriser Vos Automatisations n8n

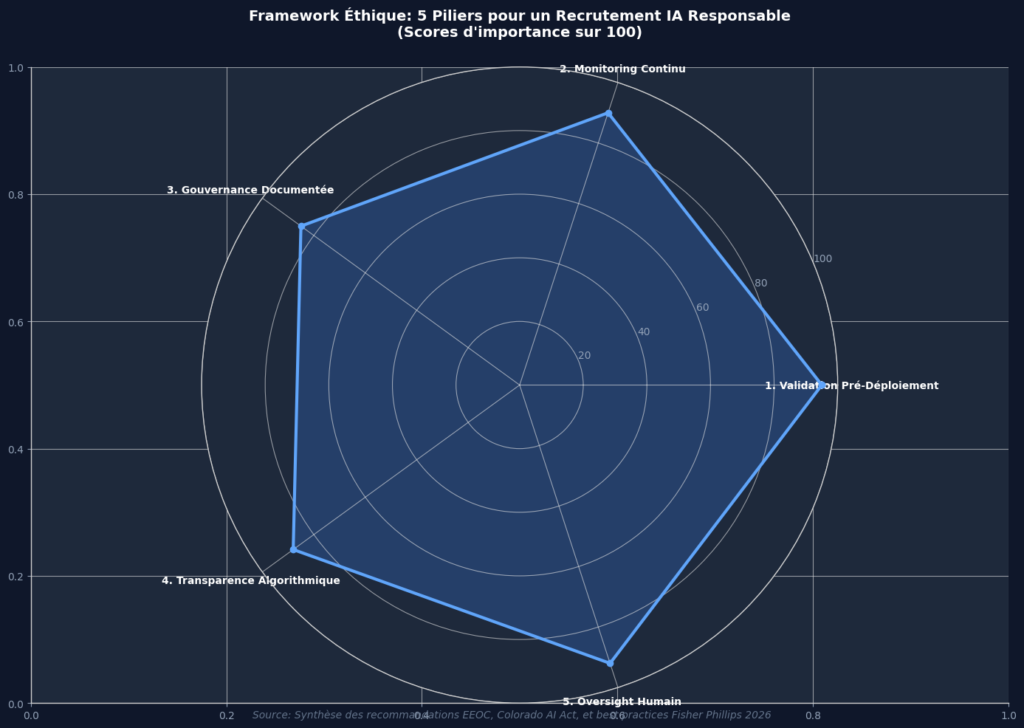

Les 5 piliers essentiels pour un recrutement IA responsable (scores basés sur les recommandations EEOC et Colorado AI Act)

Pilier 1 : Validation Pré-Déploiement (Score: 95/100)

Avant de déployer tout workflow n8n de screening :

| Test Obligatoire | Outil Technique | Seuil d’Acceptabilité |

|---|---|---|

| Disparate Impact | Fairlearn, Aequitas | Ratio ≥ 0.8 pour groupes protégés |

| Proxy Detection | SHAP, Mutual Information | Corrélation < 0.3 avec attributs sensibles |

| Flip Test | DiCE (Counterfactuals) | Variation score < 5% si nom/genre modifié |

Mon expérience : J’ai implémenté un nœud de validation Python dans mes workflows qui bloque automatiquement le déploiement si le disparate impact ratio tombe sous 0.8. Cela m’a sauvé d’une mise en production hasardeuse lors d’un recrutement pour un client tech où le dataset d’entraînement sur-représentait les profils masculins.

Pilier 2 : Monitoring Continu (Score: 90/100)

Le biais n’est pas statique. Il dérive. Mes workflows n8n intègrent désormais :

- Alertes temps réel si le taux de passage à l’entretien varie de >15% entre groupes démographiques

- Logs d’overrides : chaque fois qu’un recruteur humain conteste une recommandation IA, la raison est documentée

- Ré-entraînement trimestriel avec re-sampling des données sous-représentées

Pilier 3 : Gouvernance Documentée (Score: 85/100)

« L’algorithme l’a décidé » n’est pas une défense légale . J’ai établi pour chaque client :

- Model Cards : sources de données, exclusions, limitations connues

- Audit trails : qui a modifié quoi, quand, pourquoi

- Politiques d’utilisation alignées sur NYC Local Law 144, Colorado AI Act (effectif juin 2026)

Pilier 4 : Transparence Algorithmique (Score: 88/100)

Les « boîtes noires » créent des vides de responsabilité . Dans n8n, j’intègre :

{

"explanation_node": {

"type": "SHAP",

"outputs": ["top_3_features", "contribution_scores"],

"candidate_notification": true

}

}Chaque candidat reçoit une explication des facteurs clés ayant influencé la décision — exigence légale croissante et différentiateur éthique.

Pilier 5 : Oversight Humain Obligatoire (Score: 92/100)

L’IA doit informer, pas décider . Mon règle d’or :

Aucun rejet final sans validation humaine. Les workflows n8n peuvent trier, scorer, suggérer — mais le dernier mot revient à un être humain documenté.

🔧 Implémentation Technique : Workflow n8n Éthique en 5 Nœuds

Voici l’architecture que je déploie systématiquement :

| Étape | Nœud n8n | Fonction Éthique |

|---|---|---|

| 1. Ingestion | Webhook + Anonymisation | Suppression immédiate nom/genre/âge/photo |

| 2. Scoring | AI Model (Local/Private) | Évaluation sur compétences uniquement |

| 3. Audit | Fairness Check (Python) | Calcul Disparate Impact Ratio |

| 4. Decision | Human-in-the-Loop | Validation obligatoire pour rejets |

| 5. Feedback | Logging + Notification | Explication au candidat + audit trail |

Astuce pro : Utilisez le nœud Code de n8n pour intégrer Fairlearn et calculer vos métriques de biais en temps réel avant toute décision.

🌍 Perspectives 2026 : Le Nouveau Paysage Réglementaire

| Juridiction | Réglementation | Impact sur Workflows n8n |

|---|---|---|

| Colorado | AI Act (juin 2026) | Audits obligatoires, notices candidates |

| New York | Local Law 144 | Bias audits annuels pour outils ADT |

| Illinois | AI Video Interview Act | Consentement écrit pour analyses biométriques |

| UE | AI Act (en cours) | Classification haut risque pour recrutement IA |

| France | Référentiel CNIL | Conformité RGPD + explicabilité |

Conclusion : L’Automatisation Responsable comme Avantage Compétitif

L’affaire Workday n’est pas une menace, c’est une opportunité de différenciation. Les entreprises qui implémentent dès maintenant des workflows n8n éthiques, traçables et conformes ne se protègent pas seulement juridiquement. Elles construisent la confiance des candidats, améliorent la qualité de leurs recrutements et anticipent les réglementations qui deviendront inévitables.

Dans mon accompagnement chez PromptBuildLab, je refuse désormais tout projet d’automatisation RH qui ne passe pas le « test Mobley » : Si ce candidat était Derek Mobley, mon workflow le traiterait-il équitablement ?

Votre prochaine étape : Auditez vos workflows n8n actuels avec les 5 piliers ci-dessus. Identifiez les points de vulnérabilité. Et rappelez-vous : la meilleure automatisation est celle qui amplifie l’humain, pas celle qui l’élimine.

- Le Phénomène Anti-IA : De la Méfiance à la Révolte Mondiale

- Lunettes intelligentes et fraude : une nouvelle ère de criminalité dopée à l’IA

- GPT-5.5 vs Claude Opus 4.7 vs Kimi K2.6 : Le Comparatif Ultime des Géants de l’IA (Avril 2026)

- Claude Design : L’Outil qui Redéfinit la Chaîne de Création Digitale

- Anthropic Lance Sa Conquête des Puces IA : Pourquoi Claude Nécessite Son Propre Silicon [Analyse 2026]

![Anthropic Lance Sa Conquête des Puces IA : Pourquoi Claude Nécessite Son Propre Silicon [Analyse 2026]](https://promptbuildlab.com/wp-content/uploads/2026/04/000000096631.jpg)